Entrenar al algoritmo: gobernanza, agencia y literacidad en el uso de YouTube*

Gabriela Elisa Sued**

Universidad Nacional Autónoma de México, Instituto de Investigaciones Sociales

Recibido: 29 de septiembre del 2021 / Aceptado: 17 de noviembre del 2021

doi: https://doi.org/10.26439/contratexto2022.n037.5331

RESUMEN. Este estudio aborda las experiencias de jóvenes usuarios mexicanos con los algoritmos de recomendación de la plataforma YouTube. Busca determinar si se encuentran subordinados a la gobernanza algorítmica o si, por el contrario, son capaces de desarrollar algunas tácticas para resistir las lógicas del poder algorítmico a través de su propia agencia. Utiliza una metodología cualitativa centrada en grupos de enfoque. Evidencia que los usuarios no se subordinan completamente a las plataformas, y que sus posibilidades de agenciamiento varían en función de sus diferentes modos de apropiación tecnológica, las teorías intuitivas acerca de su funcionamiento, la capacidad para evadir las distorsiones algorítmicas, y los recursos para evaluar la calidad de la información ofertada. Como resultado del análisis, se han identificado las habilidades específicas que constituyen la literacidad algorítmica.

PALABRAS CLAVE: YouTube / algoritmos / usuarios / alfabetización digital / literacidad transmedia

Training the algorithm: governance, agency, and literacy

in the use of YouTube

ABSTRACT. This study addresses the experiences of young Mexican users with YouTube’s recommendation algorithms. It seeks to determine if they are subordinated to algorithmic governance or if, on the contrary, they are capable of developing some tactics to resist algorithmic power through their agency. It uses a qualitative methodology based on focus groups and shows that users are not entirely subordinated to the platforms. Their possibilities of agency vary depending on the different technological appropriations of the platform, the intuitive theories about the ways in which these operate, the ability to dodge algorithmic distortions, and the resources to evaluate the quality of the information offered. As a result, the study identifies the specific skills that constitute algorithmic literacy.

KEYWORDS: YouTube / algorithms / users / digital literacy / transmedia literacy

TREINAR O ALGORITMO: GOVERNANÇA, AGÊNCIA E ALFABETIZAÇÃO

NO USO DO YOUTUBE

RESUMO. O artigo aborda as experiências de jovens usuários mexicanos com os algoritmos de recomendação da plataforma YouTube. Busca-se determinar se eles estão subordinados à governança algorítmica, ou se, ao contrário, são capazes de desenvolver alguma tática para resistir a lógica do poder algorítmico a partir de sua própria agência. Utiliza-se a metodologia qualitativa centrada em grupos focais. Mostra-se que os usuários não estão completamente subordinados às plataformas e que suas possibilidades de agência variam dependendo das diferentes apropriações tecnológicas da plataforma, das teorias intuitivas sobre seu funcionamento, da capacidade de esquivar distorções algorítmicas e dos recursos para avaliar a qualidade das informações oferecidas. Como resultado da análise foram identificadas habilidades específicas que integram a alfabetização algorítmica.

PALAVRAS-CHAVE: YouTube / algoritmos / usuários / alfabetização digital / alfabetização transmídia

INTRODUCCIÓN

Los sistemas automatizados de recomendación, también conocidos como algoritmos de recomendación, son piezas de software creadas para que las plataformas sociales como Facebook, YouTube, Netflix y Spotify, entre otras, resuelvan problemas computacionales de forma eficiente. Su función principal es la de proveer a los usuarios de información que, según predicen, les será relevante (Bucher, 2018). Los algoritmos son objetos digitales creados en el ámbito ingenieril, pero se usan en entornos sociales y culturales. Por lo tanto, modelan prácticas de uso, imaginarios y decisiones. La interacción entre algoritmos y cultura ha sido tratada en la literatura especializada como una narrativa dramática que a menudo ha ignorado el rol de la agencia humana y ha adjudicado un poder considerable a las decisiones automatizadas acerca de lo que es visible, aceptable o elegible en términos sociales y culturales (Velkova & Kaun, 2021). Sin embargo, no es posible identificar precisamente la acción cultural de los algoritmos si no se estudia su uso y puesta en acción por parte de los usuarios en situaciones concretas (Seaver, 2017).

Los sistemas de recomendación deciden y visibilizan lo que puede o no ser visto. Por un lado, esta acción afecta a las decisiones de los usuarios de las plataformas; y, por el otro, implica el ejercicio de un poder acerca de lo importante y lo visible, y también, de lo secundario e imperceptible (Bucher, 2018). La cuestión del poder algorítmico ha sido trabajada en los últimos años desde el concepto de gobernanza algorítmica (Danaher et al., 2017). Supone que, en un contexto donde proliferan los datos digitales producidos dentro y fuera de la Web, existe la tendencia a dejar la toma de decisiones en manos de algoritmos y sistemas de inteligencia artificial.

Dado el papel central que tienen los algoritmos en la vida cotidiana mediada por tecnologías digitales, las recomendaciones algorítmicas afectan en gran medida a los usuarios de las plataformas sociales. Posturas extremas adjudican a los algoritmos racionalidad, autonomía y objetividad solo por sus características técnicas, pero no evalúan su desempeño en contextos específicos de uso (Roberge & Seyfert, 2018). Por este motivo, resulta de importancia conocer qué sucede con los usuarios y su agenciamiento en el acceso a la información mediado por recomendaciones automatizadas, así como identificar qué conocimientos e intuiciones ponen en juego al negociar sus decisiones con estos sistemas.

Este estudio explora las experiencias de jóvenes usuarios mexicanos con los algoritmos de recomendación de la plataforma YouTube. Busca determinar si son capaces de desarrollar tácticas para resistir las lógicas del poder algorítmico a través de su propia agencia (Velkova & Kaun, 2021); se propone identificar sus conocimientos intuitivos y críticos, y las prácticas que producen el agenciamiento y las resistencias a las recomendaciones algorítmicas no deseadas, así como sistematizar dichas prácticas y conocimientos en un conjunto de recomendaciones para el diseño de intervenciones en literacidad digital.

Nuestras preguntas de investigación son las siguientes: ¿cuáles son las teorías intuitivas y conocimientos que los usuarios poseen acerca del funcionamiento de los sistemas de recomendación de YouTube? ¿Cuáles son los elementos de la interfaz de YouTube que materializan la gobernanza algorítmica desde la perspectiva de los usuarios? ¿Cómo influyen estos conocimientos y teorías en su agenciamiento para decidir qué información consumir o dejar de lado? ¿Qué tácticas desarrollan los usuarios para resistir a la gobernanza algorítmica?

Estos objetivos e interrogantes se plantean no solo en función de profundizar en el conocimiento acerca del modo en que los algoritmos modelan la cultura digital actual, sino en el contexto de la formación de nuevas ciudadanías con habilidades digitales críticas que les permitan “identificar los sentidos y significados que se ponen en juego en los contextos digitales, y así poder analizar y tomar decisiones sobre la información, así como generar contenidos propios” (Garay Cruz & Hernández Gutiérrez, 2019, p. 13).

Este trabajo introduce un tipo específico de literacidad transmedia (Scolari, 2016; Lugo Rodríguez, 2016; Cruz Sánchez, 2019) que recientemente se ha denominado literacidad algorítmica (Ridley & Pawlick-Potts, 2021). Derivado del análisis presentado, hacia el final de este trabajo se describen las habilidades que conforman la literacidad algorítmica.

ANTECEDENTES

El marco referencial de este trabajo se ubica en los estudios de culturas algorítmicas (Striphas, 2015). En especial, se centra en las formas de gobernanza (Danaher et al., 2017), resistencia (Treré, 2019) y agenciamiento (Velkova & Kaun, 2021) algorítmicos. Además, se vincula el tema con las alfabetizaciones digitales críticas (Garay Cruz & Hernández Gutiérrez, 2019) y la literacidad transmedia (Scolari, 2016), en particular con la literacidad algorítmica (Ridley & Pawlick-Potts, 2021).

Culturas algorítmicas y YouTube

Rieder (2020) define los algoritmos como un conjunto finito de pasos bien determinados de una sola entrada y varias salidas, construidos con la suficiente simplicidad como para ser ejecutados con lápiz y papel. Distingue, además, entre la abstracción del algoritmo y su concreción en el software, es decir, la implementación del algoritmo en un programa que una computadora pueda leer. Para Dourish (2016), aquello que las ciencias sociales denominan algoritmos es en realidad un reduccionismo que refiere a “un sistema de control y gestión digital logrado a través de la detección, el almacenamiento de datos a gran escala y el procesamiento algorítmico dentro de un marco legal, comercial o industrial que le otorga autoridad” (p. 3).

Existen diferentes tipos de algoritmos según la lógica de organización de la información: los hay de búsqueda, de rankings, de interpretación y filtrado de información, de indexación de bases de datos, de entrenamiento basado en machine learning y de agrupamientos en red (Rieder, 2020). Los sistemas automatizados de recomendación son una parte central del ecosistema de medios actual. Por un lado, resultan ordenadores fundamentales de información al distinguir lo que es visible (a través del procesamiento de listas de información), lo que es prioritario (al asignar un orden al contenido de las listas), lo que será importante para un grupo de personas a través de la identificación de tendencias, y también lo que será importante para los usuarios (a través de procesos de personalización relacionados con su historial de acceso a los contenidos) (Gillespie, 2014). Por otro lado, estos procedimientos constituyen una reducción técnica de procesos cognitivos vinculados con la comunicación, la expresión y la información, por lo que también son una reducción de lo cultural a lo técnico que da lugar a una cultura algorítmica (Striphas, 2015).

Con un promedio de dos mil millones de visitas mensuales, YouTube ocupa el segundo lugar mundial entre las plataformas más visitadas (We Are Social, 2020). En México, alcanza una penetración del 61 % respecto de su población adulta total (Statista, 2021). Sus usuarios llegaron a 55 millones en el 2020 (YT Brandcast México, 2020). Más de la mitad usa YouTube a diario (Vega, 2021). La función cultural de YouTube va mucho más allá de ser una plataforma de publicación y almacenamiento de videos. Es un medio de comunicación central que produce diferentes tipos culturales contemporáneos (Burgess & Green, 2018). Por cada minuto se suben a YouTube 400 horas de video, de las cuales 8 se suben en México (César, 2017). Por eso se hace necesario un sistema complejo de algoritmos que organicen, gestionen y recomienden información.

En la interfaz de YouTube convergen múltiples algoritmos de gestión de la información. A grandes rasgos, se identifican dos tipos de sistemas de recomendaciones. Uno ofrece contenidos similares para todos los usuarios, como los que aparecen en el explorador de tendencias. El otro presenta contenidos personalizados, como los videos que se muestran en la página de inicio y las recomendaciones, listas de videos asociados al video que el usuario elige ver, o a temas de interés que se asocian al historial de videos (Rieder et al., 2018).

Gobernanza y resistencias algorítmicas

La gobernanza algorítmica se define como un conjunto de procesos en los que las decisiones tomadas por humanos se delegan a sistemas automatizados de recomendaciones. El problema es que en estos procesos se han detectado sesgos sociales, poca diversidad de información, polarizaciones entre extremos y visibilización de contenidos desinformativos. Todos estos elementos pueden potencialmente afectar las decisiones de las personas (Danaher et al., 2017).

En el contexto de una gobernanza algorítmica construida no solo desde la disponibilidad técnica, sino también desde discursividades que refuerzan su poder, la agencia y las posibilidades de acción de los usuarios son a menudo ignoradas (Velkova & Kaun, 2021). La sociología de la tecnología, corriente surgida en los años ochenta, destacó la flexibilidad interpretativa de los sistemas sociotécnicos y la importancia de los usuarios en la resignificación de estos sistemas, así como su uso para fines diferentes de los diseñados inicialmente (Pinch & Bijker, 1989). En estas acciones, los usuarios producen tácticas para construir alternativas y resistencias al poder algorítmico (Treré, 2019). Por eso resultan importantes, por un lado, el estudio de los efectos sociales de la gobernanza algorítmica (Kitchin, 2017) y, por el otro, la identificación de los modos en que los usuarios resisten al poder algorítmico haciendo uso de su agenciamiento.

Para las ciencias sociales, el conocimiento de esta cultura algorítmica representa un desafío por varios motivos. Primero, existe escasa información sobre los procesos algorítmicos de las grandes plataformas, todos ellos protegidos por el secreto industrial (Pasquale, 2016). Segundo, los algoritmos se producen en el área de la informática con procedimientos y códigos propios, pero luego se usan en las industrias mediáticas para moldear procesos culturales. Lo importante es poder observar cómo los algoritmos interactúan con sus usuarios y construyen experiencias no solo tecnológicas, sino también culturales. Por último, los algoritmos son dinámicos e inciertos en su acción. Aunque su núcleo se compone de un conjunto de pasos ordenados, los datos con que se los alimenta pueden conducir a resultados impredecibles (Kearns & Roth, 2019). Pese a estas limitaciones, existe un conjunto de trabajos que identifica y revisa con sentido crítico ciertos comportamientos recurrentes de los sistemas de recomendación de YouTube y su impacto en los contenidos ofrecidos por la plataforma.

Rieder et al. (2018) realizan un estudio centrado en datos provistos por YouTube para identificar los factores que hacen variar los resultados de su algoritmo de búsqueda en un periodo de tiempo. Las listas que arrojan los resultados de búsqueda contemplan dos dimensiones importantes: la relevancia y el ranking. La relevancia incluye todos los videos pertinentes según coincidencias entre la clave de búsqueda y los títulos, descripciones, comentarios y contenidos de imágenes. El ranking realiza un ordenamiento de la lista de resultados. Los autores encuentran que existen búsquedas cuyos resultados se sostienen en el tiempo, mientras que otras varían. Deducen que estas variaciones se deben a factores múltiples, entre los que se encuentran los volúmenes de búsqueda y publicación de un video sobre un tema determinado, el tiempo de visionado y, como variable más importante, la cantidad de suscriptores de los canales que desarrollan contenido.

El modo en que YouTube recomienda contenidos se encuentra lejos de la objetividad cultural. Por el contrario, se presentan distorsiones y falta de diversidad. Una de las primeras en referir comportamientos algorítmicos distorsionados es Tufekci (2018). La autora narra una situación en la que, luego de ver un video de un discurso sobre la campaña electoral de Donald Trump, las recomendaciones de la plataforma se tornan cada vez más hacia la extrema derecha, desde videos sobre el supremacismo blanco hasta teorías conspiracionistas, intensificando cada vez el contenido primario.

En general, la literatura indica una tendencia de las plataformas sociales a la creación de filtros burbuja (Pariser, 2014). Así se denomina a la propensión de los sistemas automatizados a recomendar una mayor cantidad de contenidos similares a los que interesan a los usuarios, sea en términos de conexiones o de contenidos. Acerca de los filtros burbuja en YouTube, Kaiser y Rauchfleisch (2020) analizan recomendaciones automatizadas de canales de Estados Unidos y Alemania. Concluyen que los usuarios que acceden a información noticiosa producida por medios principales pueden en pocos clics llegar a contenidos de extrema derecha, y quedarse largo rato en una burbuja que solamente presenta dichos puntos de vista. Sin embargo, desde estas burbujas no se realiza el camino opuesto hacia contenidos noticiosos. Del mismo modo, los pequeños canales de contenidos políticos recomiendan a los más grandes, pero no sucede lo opuesto. Sued (2020) llega a una conclusión similar al estudiar las burbujas de filtro producidas por contenidos antivacunas en el contexto de la pandemia por el COVID-19.

Por otra parte, Bishop (2019), estudiando vloggers de belleza, encuentra una jerarquía de visibilización asociada a la clase, la raza y los estereotipos de género. El algoritmo favorece en sus búsquedas a actores de clase media que se vinculan estrechamente con patrones de consumo, belleza, moda y modos de relacionamiento muy similares a los de la prensa juvenil, sin presentar modelos alternativos.

Lukoff et al. (2021) examinan los diferentes elementos de la interfaz de YouTube que dotan a los usuarios de mayor o menor agenciamiento y, por ende, de mayor control frente a las decisiones de las plataformas. Sistemas de búsqueda, suscripciones y listas de reproducción pertenecen al primer grupo, mientras que recomendaciones automatizadas, sugerencias en el perfil y avisos publicitarios los hacen sentir con menor control.

En esa dirección, también han sido investigadas las creencias y teorías intuitivas que los usuarios poseen sobre los funcionamientos algorítmicos de las plataformas sociales, dado que estas suelen orientar decisiones y prácticas. Las teorías intuitivas son implícitas e imprecisas, pero tienen importantes implicancias: organizan la experiencia, generan inferencias, guían el aprendizaje e influencian la conducta y las interacciones sociales. Siles et al. (2020) estudian las teorías intuitivas de los usuarios de Spotify en Costa Rica. Los autores identifican dos categorías. Unos tienden a personificar a la plataforma como un ser que los vigila y conoce todas sus preferencias, mientras que otros la caracterizan como una gran máquina de recursos que ofrece recomendaciones adecuadas con un buen entrenamiento. Los autores destacan cómo estas teorías intuitivas ayudan a los usuarios a tomar decisiones acerca de cómo usar la plataforma.

Luego de una búsqueda en las bases de datos Scopus y SciELO, no se han identificado estudios acerca de las experiencias de los usuarios con los sistemas de recomendación de YouTube en América Latina. Este trabajo busca contribuir a una mayor comprensión de los usos de las plataformas sociales en la región.

De la literacidad digital a la literacidad algorítmica

Lugo Rodríguez (2016) distingue dos líneas de trabajo dentro de las alfabetizaciones digitales. La primera comprende las intervenciones formales orientadas a la adquisición de los saberes tecnológicos necesarios para desempeñarse en la sociedad contemporánea, intervenciones de las que, al menos en teoría, la escuela y demás instituciones de formación de ciudadanía deberían ocuparse. La segunda línea considera que la alfabetización transmedia sucede durante la apropiación tecnológica, sin necesidad de mediación institucional. Varios autores (Cruz Sánchez, 2019; Hernández y Hernández et al., 2019) prefieren llamar literacidad a la segunda forma, ya que el término designa el proceso de forma neutra y, además, destaca la secuencia de incorporación de saberes en contexto, más allá de las mediaciones escolares e institucionales. Dentro de la literacidad transmedial se ubican las destrezas, habilidades y actitudes puestas en juego en el uso de las tecnologías digitales (Scolari, 2016). Algunas de las muchas literacidades transmediales identificadas son la localización y el acceso a la información, la gestión de la identidad digital, la conciencia de la convivencia sociodigital, la conceptualización de los intereses comerciales de las plataformas sociales y el pensamiento crítico (Cruz Sánchez, 2019).

A pesar de todos los avances realizados por los estudios de alfabetización y literacidad digital, todavía es necesario profundizar en nuevos elementos, que se añaden a la ecología digital a medida que comienzan a conceptualizarse como objetos de estudio. Uno de estos elementos es la acción algorítmica de las plataformas sociales. La literacidad algorítmica refiere al conjunto de habilidades que permite

razonar sobre los algoritmos y sus procesos, reconocer e interpretar su uso en sistemas, crear y aplicar técnicas algorítmicas y herramientas en una variedad de dominios, evaluar la influencia y los efectos de los algoritmos en contextos sociales, culturales y políticos, y posicionar al individuo como co-constituyente en tomas de decisiones algorítmicas. (Ridley & Pawlick-Potts, 2021, p. 4)

Este trabajo indaga en la literacidad algorítmica a través del análisis de prácticas de búsqueda, acceso y evaluación de la información en YouTube, con el fin de identificar las usadas para eludir o suavizar las distorsiones y sesgos algorítmicos basados en la falta de diversidad de contenidos, priorización de intereses comerciales en los rankings, desinformación, polarización de resultados y burbujas de filtro.

MÉTODO

La etnografía digital (Hine, 2015) remarca la importancia de estudiar las interacciones digitales como un entramado de humanos y objetos tecnológicos. En este sentido, Seaver (2017) ha abierto el camino para estudiar las experiencias algorítmicas de los usuarios con métodos cualitativos. Propone abordarlas como procesos donde las secuencias rígidas de instrucciones interactúan con usuarios de formas múltiples, variables y abiertas. Los algoritmos intervienen en la vida cotidiana cuando son puestos en acción en un proceso que no distingue de modo rígido entre lo social y lo técnico. La experiencia algorítmica es una herramienta formulada desde la perspectiva de los usuarios para entender cómo estos perciben los algoritmos y en qué medida son influenciados por ellos (Alvarado & Waern, 2018). Alvarado et al. (2020) estudian las percepciones de usuarios adultos de mediana edad acerca del algoritmo de YouTube en cuatro países. Los autores identifican que, desde la perspectiva de los usuarios, tres elementos influyen en los sistemas de recomendación de YouTube: el comportamiento en la plataforma tanto propio como de otros usuarios, el algoritmo como actor que vincula los propios consumos con otros similares y, por último, las acciones de YouTube como empresa con intereses propios.

Este estudio se enfoca en las experiencias algorítmicas en YouTube de un conjunto de 45 jóvenes, de entre ١٨ y ٢٣ años, usuarios habituales de la plataforma. Los participantes son estudiantes de una universidad mexicana de varias carreras de humanidades y ciencias sociales. Todos residen en la ciudad de Querétaro, México. Según una encuesta suministrada al comenzar el estudio, YouTube es la plataforma audiovisual más usada en comparación con otras. El 51 % la usa a diario, el 30 % lo hace de vez en cuando, y el restante 20 % lo hace día por medio. Además, el 11 % publica o ha publicado videos frecuentemente en la plataforma. La encuesta contenía, además, preguntas cerradas con opciones acerca de la experiencia de los usuarios con la plataforma: la atención que se presta a la página de inicio, el nivel de conformidad con las recomendaciones de la plataforma y la identificación de noticias falsas en los perfiles.

Para interrogar a los consultados acerca de sus experiencias algorítmicas con YouTube, se entrevistó a 45 participantes divididos en seis grupos de enfoque —técnica cualitativa de investigación donde los participantes son interrogados colectivamente acerca de un tema específico por un moderador (Croucher & Cronn-Mills, 2018)—, lo que se desarrolló mediante videoconferencia entre agosto del 2020 y marzo del 2021. Cada grupo tuvo una duración promedio de cuarenta minutos y fue registrado mediante videograbación. La primera actividad del grupo de enfoque consistió en la realización de bocetos y esquemas que representaban la idea de funcionamiento del algoritmo de YouTube. Dichos esquemas se basan en el concepto de rich pictures, cuya traducción es “imagen enriquecida”. Su finalidad es la de expresar visualmente mediante papel y lápiz un conjunto de relaciones entre partes en un sistema complejo. Se conectan con pensamientos difíciles de expresar, y ayudan a las personas a pensar y a actuar (Bell & Morse, 2013). Resultan un recurso interesante para que estas puedan representar sus teorías nativas sobre el funcionamiento de sistemas complejos como los algoritmos (Siles et al., 2020). Los participantes compartieron sus esquemas en un panel colaborativo dentro de una plataforma web. Así pudieron obtener una visión del conjunto de los gráficos. Estos esquemas, además, sirvieron de punto de partida para la conversación acerca de las diferentes vías de acceso a contenidos en YouTube. Luego se prosiguió de acuerdo con una guía elaborada previamente por el moderador, que incluía preguntas acerca de las maneras en que los participantes acceden y seleccionan los videos, el tipo de elementos —como canal, cantidad de visualizaciones, títulos y miniaturas— que se consideran en las elecciones, el uso del buscador, su opinión general sobre la plataforma y el funcionamiento de su sistema de recomendación, la identificación de noticias falsas o sesgos de algún tipo, y los usos cotidianos de YouTube.

En la próxima sección, se da cuenta de los resultados obtenidos por medio de las tres técnicas —la encuesta, los esquemas y los grupos de enfoque— de forma unificada.

RESULTADOS

YouTube es una plataforma importante para la vida cotidiana de los consultados. Si bien uno de los usos principales es el entretenimiento, su funcionalidad supera en mucho la de pasatiempo. Es una herramienta usada para el aprendizaje formal o informal, para conseguir información operativa en la vida cotidiana, y para la formación de puntos de vista sobre el mundo. Incluso, para ciertos usuarios, la producción de videos puede ser una alternativa profesional.

Es relevante señalar que no existe un único modelo de usuario de YouTube. Cada usuario accede a la plataforma de acuerdo con un conjunto de finalidades de uso, conocimientos previos y teorías intuitivas sobre el funcionamiento de la plataforma. Entre los consultados, identificamos tres tipos generales de usuarios: los produsuarios (Bruns, 2008), que consumen, pero también producen o han producido videos; los consumidores, quienes miran videos como medio de entretenimiento; y, finalmente, los consumidores interesados en contenidos políticos y sociales, quienes usan la plataforma para informarse de una selección de temas actuales, como sustentabilidad, feminismo, conflictos violentos y movimientos sociales.

Cada uno de estos grupos sostuvo diferentes tipos de teorías intuitivas sobre la plataforma, y se mostró como usuario con diferente nivel de agenciamiento y, por consiguiente, con diferente nivel de resistencia frente a la gobernanza algorítmica. A continuación, se detallan los hallazgos.

Teorías intuitivas sobre el funcionamiento de YouTube

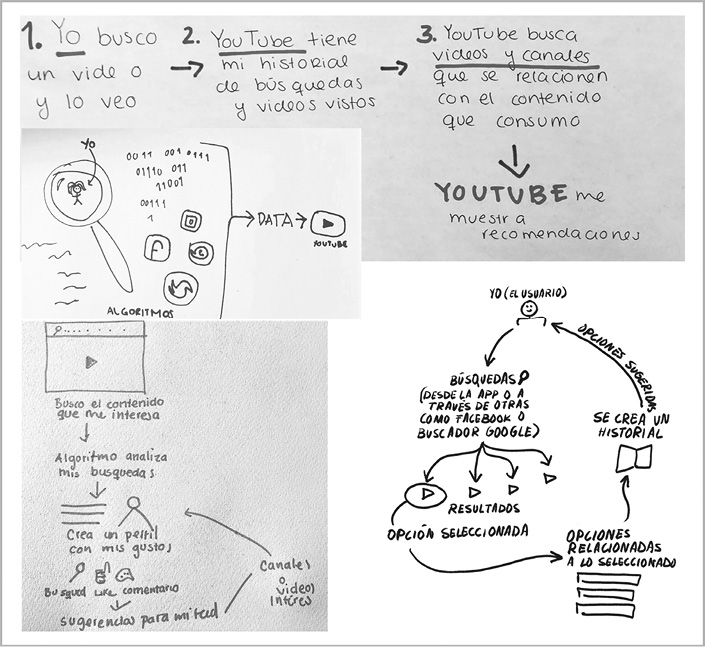

Los diagramas evidenciaron diferentes tipos de teorías intuitivas sobre las recomendaciones. Un primer grupo, asociado a quienes usan la plataforma para entretenerse, sostiene una teoría centrada en las búsquedas y el rol fundamental de los usuarios consumidores (véase la figura 1).

Figura 1

Diagramas centrados en las búsquedas y los usuarios

Este grupo, que incluye en su mayoría a los usuarios que consumen videos como entretenimiento, identifica las búsquedas temáticas como el elemento de entrada, y las recomendaciones de la plataforma como elementos de salida del algoritmo. Los elementos presentes en este grupo son el buscador y el historial de videos de YouTube, y sobre todo las iniciativas de los usuarios de buscar información. Algunos esquemas incluyen búsquedas en otras plataformas, pero no explicitan cómo se transfiere la información entre plataformas. Como resultado, emergen visiones simplificadas que se corresponden con la importancia que se le da al buscador en las decisiones acerca del contenido, y que suponen un funcionamiento principalmente personalizado, donde el usuario es el actor principal y los procesos algorítmicos e intereses propios de las plataformas permanecen ocultos.

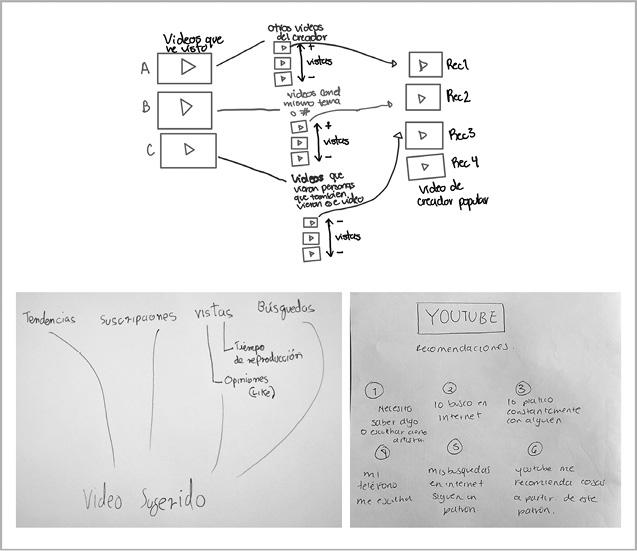

Un segundo grupo construyó una teoría multifactorial, en la que incluye diferentes valores de entrada al algoritmo de recomendación. Se encuentran entre ellos la recolección de datos dentro y fuera de la plataforma, las preferencias de usuarios similares, las suscripciones y vistas (véase la figura 2). Aunque la mayoría de ellos no incorpora todo el proceso de producción, circulación y consumo de videos, estas visiones son menos simplificadas que las del primer grupo y se asocian al grupo de usuarios interesados en contenidos de actualidad.

Figura 2

Diagramas centrados en múltiples factores

Por último, los creadores de contenido tienen una visión que, a diferencia de los consumidores, incluye la instancia de producción del video y dan mayor importancia a las suscripciones que a las búsquedas. Solo una minoría de consultados incorporó a los creadores de contenido a sus diagramas, que manejan la teoría intuitiva más compleja. Esto nos da la pauta de que los usuarios familiarizados con la producción de videos perciben de un modo más preciso la gobernanza algorítmica.

Las tres teorías descritas atribuyen diferente incidencia a los elementos de la interfaz en la configuración de las recomendaciones. La primera considera que la interfaz es prácticamente transparente, y que las recomendaciones algorítmicas coinciden con las búsquedas de los usuarios. La segunda problematiza más el rol de las reacciones de los usuarios y las suscripciones, vinculando estas actividades con las recomendaciones que luego reciben. El tercer grupo, que ha experimentado la creación de contenidos, agrega a la incidencia de los elementos de la interfaz los intereses comerciales de las plataformas en las lógicas algorítmicas. Estas diferencias en las teorías intuitivas serán retomadas en la discusión como factor explicativo de las distintas formas de agenciamiento, ya que las teorías intuitivas “organizan la experiencia, generan inferencias, guían el aprendizaje e influencian la conducta y las interacciones sociales” (Gelman & Legare, 2011, p. 380).

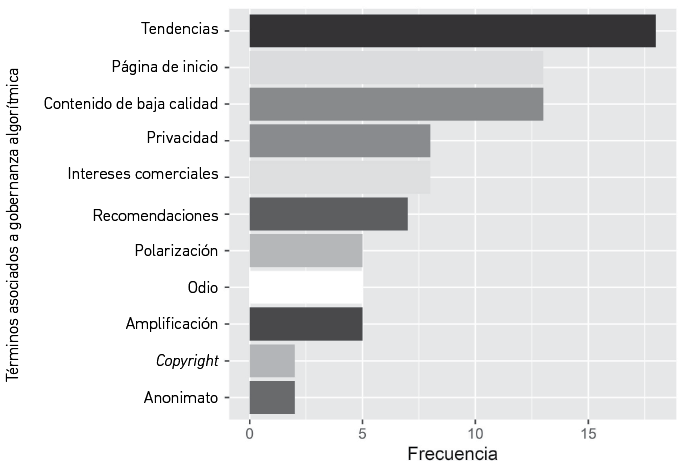

Percepciones de la gobernanza algorítmica

Los usuarios perciben la gobernanza en varios aspectos (véase la figura 3). El primero y más frecuente se refiere a los contenidos no personalizados que se ubican en la página de inicio. Entre ellos se encuentra, por un lado, la pestaña de tendencias, que incluye novedades o fenómenos noticiosos. Los consultados la vinculan con intereses comerciales y publicitarios de las plataformas. Por el otro, expresan haber encontrado videos ofensivos o de moral cuestionable. El segundo aspecto se centra en la poca flexibilidad de las recomendaciones automatizadas frente al dinamismo de las búsquedas de los usuarios. Los sistemas de recomendación son vistos como rígidos, poco dinámicos y diversos. El hecho de que un usuario haga una sola búsqueda y mire uno o dos videos sobre un tema lleva a que aparezcan varias recomendaciones en la página de inicio que no son de interés o que lo fueron de modo transitorio. El tercer aspecto es la baja calidad y desconfianza hacia contenidos recomendados en la página de inicio: “Hay mucho contenido vacío que no te va a ayudar en nada en realidad, y a veces puedes caer [en] ese tipo de trampa y perder horas viendo contenido que en realidad no te aporta nada”. Por último, se recogieron referencias a la privacidad de los datos recolectados por otras plataformas, como WhatsApp, Facebook o Instagram. Esta dimensión de vigilancia se acompaña por una teoría intuitiva que personifica a las plataformas y que se materializa en enunciados como “Mi teléfono me escucha”, “No sé bien cómo, pero ellos saben lo que te gusta”. Estos cuatro aspectos tornan poco confiables a los sistemas automatizados y los relativizan como recurso para ampliar intereses.

Figura 3

Términos asociados a la gobernanza algorítmica y su frecuencia en el discurso de los entrevistados

Nota. Elaboración propia a partir del análisis de palabras coocurrentes en el registro directo de los consultados con tidytext, paquete de minería de textos en R (Silge & Robinson, 2016).

Los funcionamientos algorítmicos más estudiados por la literatura crítica, como las burbujas de filtro y la amplificación algorítmica, así como la desinformación, son referidos con mayor frecuencia por los usuarios interesados en cuestiones políticas y sociales, pero menos por aquellos que usan YouTube como entretenimiento o como herramienta para el aprendizaje. Por ejemplo, usuarios interesados en resolución de crímenes han encontrado apología de asesinatos, o en discusiones sobre religión, posturas antisemitas y supremacistas blancas. Dicen haber llegado a ellos con relativa facilidad, y ponen en juego algunas tácticas —que se describen más adelante— para intentar compensar la amplificación de este tipo de contenidos en sus perfiles.

Existe una distinción entre produsuarios y consumidores respecto de la gobernanza algorítmica. Los primeros identifican acciones de desmonetización, eliminación de videos, reclamos por derechos de autor y demás decisiones tomadas por las plataformas sin previo aviso a los productores de contenido. También tienen en cuenta cómo la venta de espacios publicitarios modela los contenidos de los videos en función de lo que es socialmente aceptable y familiarmente visible, y cómo la orientación y el humor de los conductores cambia para orientarse a estos requerimientos. Estas afirmaciones son consistentes con las teorías intuitivas de los usuarios: quienes identifican la mediación de las reacciones de los usuarios y los intereses comerciales de las plataformas, entienden que las recomendaciones automáticas se encuentran mediadas por dichos elementos. Por el contrario, para quienes asocian las recomendaciones directamente con sus búsquedas, la gobernanza algorítmica es percibida en menor medida. El próximo apartado retoma el proceso de búsqueda como elemento de agenciamiento.

Agencia

La mayoría de los consultados, un 80 % en la encuesta suministrada, dice sentirse cómodo con las recomendaciones de la plataforma, y se detiene en ellas muy frecuentemente. La cantidad de consultados que dice haber encontrado frecuentemente desinformación en su perfil es muy baja, menos del 10 %, pero más de la mitad afirma haber encontrado información falsa alguna vez.

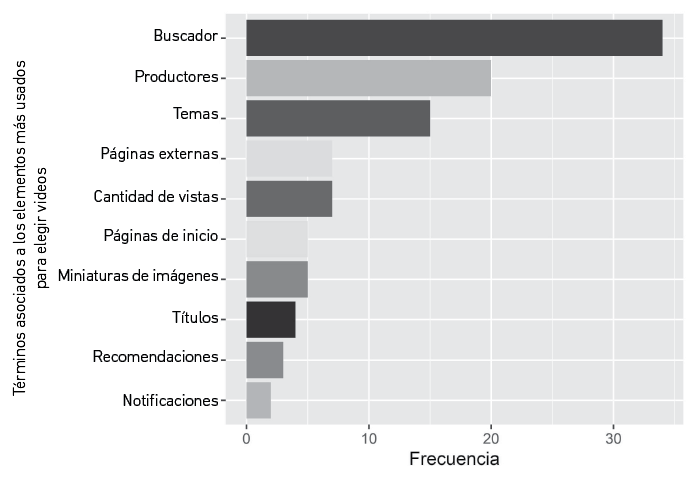

El tema del video es el elemento que inicia el proceso de búsqueda. Decidido este, se despliegan diferentes acciones. La más habitual es el uso del buscador de la plataforma. A continuación, el procedimiento más usual es detenerse en el productor del video: si es conocido, si parece experto o si es un canal al que se está suscrito. Criterios secundarios al productor del canal son las imágenes de presentación, la cantidad de vistas, las recomendaciones y las notificaciones, en ese orden de frecuencia (véase la figura 4).

Las decisiones que conllevan mayor agenciamiento son las que se toman al inicio del proceso, en la decisión del tema, la ejecución de la búsqueda y la decisión de qué video seleccionar. Luego del primer video, pueden dejarse llevar por las sugerencias asociadas. En oposición a las recomendaciones en la página de inicio, que son vistas como elementos de gobernanza, el buscador se percibe como un elemento de agenciamiento donde se ejerce la libertad de elección: “Yo uso YouTube nada más para meterme a buscar lo que quiero y de ahí las sugerencias que salen como en la barrita del lado derecho. Esas las llego a utilizar, pero las de la página inicial casi nunca”.

Figura 4

Términos asociados a los elementos más usados para elegir videos y su frecuencia en el discurso de los entrevistados

Nota. Elaboración propia a partir del análisis de palabras coocurrentes en el registro directo de los consultados con tidytext, paquete de minería de textos en R (Silge & Robinson, 2016).

Al algoritmo de búsqueda se le otorga el criterio de pertinencia, pero no siempre el de relevancia. Recibidas las recomendaciones, los usuarios aplican sus propios criterios de selección. Elementos como el canal o el productor que publica el video, las suscripciones o la cantidad de visualizaciones ayudan a decidir qué video ver.

Los produsuarios son más selectivos en función de los videos que consumen: tienen en cuenta tanto la fuente de procedencia del video como su título y la miniatura de la imagen. Saben discriminar entre títulos informativos y aquellos que solo buscan aumentar la cantidad de vistas. Confían más en las miniaturas de imagen donde se ven personas que en las que no se ven.

En general, se reconoce también que de entre la gran cantidad de resultados que puede arrojar una búsqueda, finalmente, se eligen los que más vistas poseen. Los consultados reconocen que esta práctica va en detrimento de videos que pueden tener buena calidad, pero menos vistas. Sin embargo, siguen el criterio cuantitativo para tomar la decisión.

Tácticas frente a la gobernanza algorítmica

Treré (2019) denomina tácticas a las acciones que, en una relación de fuerzas, permiten a los más débiles negociar, experimentar y adaptarse frente a las estrategias del poder. En este apartado, llamamos tácticas a las acciones que los usuarios ejercen para resistir la gobernanza, al intentar la reorientación de los algoritmos de recomendación hacia sus propios intereses.

Se identificaron tres tácticas llevadas a cabo por los usuarios para resistir la gobernanza algorítmica. La primera consiste en mirar más videos publicados por canales a los que están suscritos si la página de inicio sugiere recomendaciones que no coinciden con los intereses permanentes de los usuarios. La segunda consiste en abstenerse de buscar intereses pasajeros, porque los sistemas automatizados cambian rápidamente las páginas de inicio según las nuevas búsquedas. La tercera resulta la única táctica que parece funcionar sin subordinación a la gobernanza, ya que directamente ignora las recomendaciones insistentes de la plataforma:

Hay, por ejemplo, videos que se vuelven muy virales sobre gente de derecha. Un tipo llega, se sienta a la mesa y pide que debatan con él. Me metí a ver de qué iba y me frustré rápidamente. Después de un tiempo me di cuenta de que con estas personas no se puede discutir bien. Y no me gustó el contenido. Pero a partir de que es eso, es como que el algoritmo se agarra de ahí y entonces te empieza a intentar meter ese contenido constantemente. Y es algo que tienes que evitar, por un buen rato. Pues yo he llegado a solo evitar esos videos. O sea, no, ni por curiosidad llegar a meterme. Porque no quiero que me estén recomendando eso constantemente.

Se identificaron también algunas resignificaciones lúdicas de la vigilancia de datos ejercida por las plataformas. Una consultada, luego de explicar su sensación de ser escuchada por su teléfono, afirma: “Pues ya lo uso a mi favor, ya empezamos a decir propaganda, marketing, Querétaro y así le empiezas a decir, pues ya te sale como que juegas con el algoritmo también”.

Además, existe la confianza en poder “entrenar” al algoritmo si se usa la plataforma lo suficiente, de modo que responda a los intereses del usuario:

Creo que justo cuando no te metes mucho a YouTube, el algoritmo no está entrenado o no te puede entender, entonces te da como recomendaciones las tendencias, entonces tú entras, pero a mí no me interesa el maquillaje. Pero es justo porque el algoritmo no ha visto todavía o no ha analizado lo que te gusta.

Ante la consulta acerca de propuestas para mejorar la interacción con la plataforma y los contenidos ofrecidos, existe un reconocimiento de la necesidad de mayor alfabetización crítica para deslindar la información confiable de la falsa, ambigua u ofensiva.

De acuerdo con lo señalado por Rieder et al. (2018), los sistemas de recomendación son sensibles a la novedad y la contingencia. Las recomendaciones cambian apenas se realizan nuevas búsquedas. Pero de los dichos de los consultados, puede deducirse que no se instala un equilibrio entre lo estable y lo contingente. Si bien mediante estas tácticas los usuarios pueden lograr que las recomendaciones automatizadas se alineen con sus intereses, también los lleva a pasar más tiempo en la plataforma en algunos casos, a abstenerse de buscar información novedosa, o a quedarse en la propia burbuja de contenidos. Son tácticas que juegan a favor de los usuarios, pero que no llegan a resistir la gobernanza porque siguen la lógica de funcionamiento del algoritmo: menor diversidad de contenido, poca introducción de novedades y mayor tiempo dentro de la plataforma.

Este trabajo ha evidenciado las experiencias algorítmicas de un grupo de jóvenes usuarios en YouTube a partir de sus teorías intuitivas sobre la plataforma, sus percepciones acerca de la gobernanza algorítmica, la agencia y las tácticas de resistencia algorítmica que ponen en juego. Sus hallazgos demuestran que los usuarios no se subordinan completamente a la gobernanza algorítmica y encuentran algunas tácticas para resistirla y ejercer su agencia.

En el caso de los usuarios consultados, existe un agenciamiento motivado por diferentes factores. Primero, la existencia de distintas teorías intuitivas sobre el funcionamiento de YouTube, que promueven diferentes modos de acción. Los usuarios que elaboran teorías intuitivas considerando la incidencia de las reacciones de los usuarios en términos de likes, visualizaciones, compartidos y suscripciones, así como los intereses comerciales de las plataformas en las recomendaciones automatizadas, son quienes poseen capacidad de agencia y se encuentran en mejores condiciones de elaborar tácticas de resistencia. En el otro extremo, aquellos que han construido teorías interpretativas más reduccionistas, asociando directamente el proceso de búsqueda de videos a las recomendaciones de la plataforma, tienden a usar en mayor medida la reproducción automática. Segundo, las diferentes configuraciones de uso permiten desarrollar diversos agenciamientos. En el caso de este estudio, quienes emplean tácticas de resistencia son aquellos que usan YouTube para fines informativos y para la producción de contenidos, mientras que quienes usan YouTube para entretenimiento tienden a ser menos conscientes de la mediación de la plataforma en la oferta de contenidos especializados. En tercer lugar, gran parte del agenciamiento es brindado por la capacidad de los usuarios de ejercer un conocimiento crítico sobre la plataforma, sus elementos y los productores de video. Entre estos se encuentran: las suscripciones a canales como indicadores de confianza, el análisis de los diferentes elementos paratextuales de los videos —como títulos, miniaturas, cantidad de reproducciones y comentarios— y la verificación de su fuente de procedencia. Los usuarios identifican también las distorsiones algorítmicas reconocidas por la literatura relevada en este estudio, como las burbujas de filtro estudiadas por Pariser (2014) y Kaiser y Raufleisch (2020), la intensificación de contenidos identificada por Tufecki (2018), así como pueden distinguir el poder de los algoritmos para invisibilizar ciertos rasgos de clase y raza, tal como verifica Bishop (2019).

Entre las tácticas se encuentran las de dar mayor importancia a los contenidos de los canales a los que se está suscrito para liberar la página de inicio de recomendaciones no deseadas, abstenerse de realizar búsquedas contingentes para no desviar a los algoritmos de los intereses permanentes, o directamente ignorar las recomendaciones de las páginas de inicio. Se ha evidenciado, además, que el buscador es el principal elemento en el que se materializa la agencia de los usuarios, seguido por las suscripciones a los canales de preferencia. La verificación de la fuente del video es el recurso más usado para otorgar confianza a la información, pero los mismos consultados admiten que necesitan más elementos para poder distinguir la información confiable de la que no lo es. Estas tácticas muestran que existe una posibilidad de maniobra frente a la gobernanza algorítmica por parte de los usuarios, y que no todo el contenido consumido es el impuesto por la gobernanza algorítmica. Tal como indican Velkova y Kaun (2021), la profundización en la experiencia algorítmica de los usuarios permite salir de las narrativas trágicas donde los usuarios son completamente gobernados por los algoritmos.

Sin embargo, es necesario notar que las tácticas y las prácticas puestas en juego son pocas en comparación con la complejidad de los funcionamientos algorítmicos de las plataformas. Desde el punto de vista de los consultados, la gobernanza algorítmica se materializa en los contenidos no personalizados, la invasión a la privacidad, la publicidad no deseada, la poca diversidad de contenidos que lleva a la polarización de posiciones, y la falta de información acerca de la confiabilidad de los contenidos. Futuros estudios deben determinar los efectos a mayor escala de la gobernanza algorítmica. El buscador de la plataforma y las suscripciones a canales de confianza, así como la evaluación crítica de la información y el conocimiento de las distorsiones y sesgos en que pueden incurrir las recomendaciones automatizadas, son elementos fundamentales para resistir la gobernanza algorítmica, y también para que YouTube obtenga cierta flexibilidad interpretativa en favor de los usuarios (Pinch & Bijker, 1989).

Siguiendo la línea de la literacidad transmedia, estos hallazgos derivan en una identificación precisa de las habilidades necesarias para la literacidad algorítmica definida por Ridley y Pawlick-Potts (2021). Primero, la conciencia del funcionamiento complejo de los sistemas de recomendación pone en evidencia los intereses comerciales y políticos de las plataformas. Segundo, la distinción entre las diferentes funciones de los elementos de las plataformas con relación a las posibilidades de los usuarios habilitará un mayor agenciamiento y libertad de acción. En otras palabras, usar más los buscadores mediante claves decididas por los usuarios puede ser más eficiente en términos de agenciamiento que el uso de la reproducción automática o la visualización de las recomendaciones de la página de inicio. Tercero, los elementos paratextuales de los videos permiten una evaluación crítica para una mejor toma de decisión acerca de la información ofertada. Por último, el reconocimiento de que los algoritmos no son objetos neutros dará lugar a tácticas para sortear las distorsiones, los sesgos y la falta de diversidad. Por último, la apropiación tecnológica basada en la producción de videos otorga a los usuarios una visión más compleja del funcionamiento de las plataformas que incluye elementos no siempre notados por los consumidores. Entre ellos se cuentan la monetización, la influencia de los intereses comerciales en la selección de temáticas por parte de los productores, y la dependencia de los criterios de las plataformas para crear un canal de contenidos que pueda sostenerse en el tiempo. Los consultados en este estudio adquieren literacidad transmedia en ambientes informales y en la práctica (Cruz Sánchez, 2019; Hernández y Hernández et al., 2019). Este estudio corrobora que en ellos se ponen en juego ciertas tácticas y habilidades (Scolari, 2016), principalmente críticas y de observación. El aporte de este estudio consiste en la identificación de dichas tácticas y habilidades, que pueden luego reaprovecharse en el diseño de intervenciones formales de alfabetización (Lugo Rodríguez, 2016).

La homogeneidad y el tamaño de la muestra otorgan la certeza de que estas afirmaciones son válidas para un grupo de estudiantes universitarios sensibilizados con el uso intensivo de plataformas digitales, y señala que, a mayor conocimiento de las interfases de las plataformas, mayor posibilidad de desarrollar tácticas de resistencia a la gobernanza algorítmica. Sin embargo, en sus características homogéneas, la muestra posee la limitación de no poder generalizar el estudio hacia todo tipo de usuario de YouTube. Hace falta realizar más estudios en otros grupos etarios y de diferente nivel educativo para profundizar en las experiencias algorítmicas de diferentes tipos de usuarios, en los que puede variar la percepción de la gobernanza, así como las tácticas de resistencia algorítmica. Este trabajo brinda pautas para que dichos estudios puedan realizarse en un futuro.

CONCLUSIONES

Este trabajo buscó determinar en qué medida los usuarios se subordinan o resisten a la gobernanza algorítmica en las recomendaciones de contenidos. Ha identificado que los usuarios no se subordinan completamente a las plataformas, y que sus posibilidades de agenciamiento varían en función de sus apropiaciones tecnológicas, las teorías intuitivas acerca de su funcionamiento, su capacidad para evadir las distorsiones algorítmicas, y sus recursos para evaluar la calidad de la información ofertada. Como resultado del análisis, se han identificado las habilidades específicas que constituyen la literacidad algorítmica.

Futuros estudios podrán realizar el mismo análisis sobre otras plataformas sociales a fin de determinar las posibilidades de agenciamiento en un entorno digital de creciente automatización.

REFERENCIAS

Alvarado, O., Heuer, H., Vanden Abeele, V., Breiter, A., & Verbert, K. (2020). Middle-aged video consumers’ beliefs about algorithmic recommendations on YouTube. Proceedings of the ACM on Human-Computer Interaction, 4(CSCW2), artículo 121. https://doi.org/10.1145/3415192

Alvarado, O., & Waern, A. (2018). Towards algorithmic experience: initial efforts for social media contexts. En Proceedings of the 2018 CHI Conference on Human Factors in Computing Systems (pp. 1-12). Association for Computing Machinery. https://doi.org/10.1145/3173574.3173860

Bell, S., & Morse, S. (2013). How people use rich pictures to help them think and act. Systemic Practice and Action Research, 26(4), 331-348. https://doi.org/10.1007/s11213-012-9236-x

Bishop, S. (2019). Managing visibility on YouTube through algorithmic gossip. New Media & Society, 21(11-12), 2589-2606. https://doi.org/10.1177/1461444819854731

Bruns, A. (2008). The future is user-led: the path towards widespread produsage. Fibreculture Journal, 11. http://eleven.fibreculturejournal.org/fcj-066-the-future-is-user-led

-the-path-towards-widespread-produsage/

Bucher, T. (2018). If… Then: algorithmic power and politics. Oxford University Press.

Burgess, J., & Green, J. (2018). YouTube. Online video and participatory culture. Polity Press.

César, A. (2017, 25 de octubre). Cada minuto suben 8 horas de video a YouTube en México. El Financiero. https://www.elfinanciero.com.mx/tech/cada-minuto-suben-horas-de-video-a-youtube-en-mexico/

Croucher, S. M., & Cronn-Mills, D. (2018). Understanding communication research methods (2.a ed.). Routledge.

Cruz Sánchez, I. (2019). Literacidad transmedial. Habilidades para vivir en el siglo xxi. En L. M. Garay Cruz & D. Hernández Gutiérrez (Coords.), Alfabetizaciones digitales críticas (pp. 105-128). Universidad Autónoma Metropolitana Unidad Lerma; Juan Pablos Editor.

Danaher, J., Hogan, M. J., Noone, C., Kennedy, R., Behan, A., De Paor, A., Felzmann, H., Haklay, M., Khoo, S.-M., Morison, J., Murphy, M. H., O’Brolchain, N., Schafer, B., & Shankar, K. (2017). Algorithmic governance: developing a research agenda through the power of collective intelligence. Big Data & Society, 4(2). https://doi.org/10.1177/2053951717726554

Dourish, P. (2016). Algorithms and their others: algorithmic culture in context. Big Data & Society, 3(2). https://doi.org/10.1177/2053951716665128

Garay Cruz, L. M., & Hernández Gutiérrez, D. (2019). Introducción. En L. M. Garay Cruz & D. Hernández Gutiérrez (Coords.), Alfabetizaciones digitales críticas (pp. 9-21). Universidad Autónoma Metropolitana Unidad Lerma; Juan Pablos Editor.

Gelman, S. A., & Legare, C. H. (2011). Concepts and folk theories. Annual Review of Anthropology, 40(1), 379-398. https://doi.org/10.1146/annurev-anthro-081309-145822

Gillespie, T. (2014). The relevance of algorithms. En T. Gillespie, P. J. Boczkowski & K. A. Foot (Eds.), Media technologies: essays on communication, materiality, and society (pp. 167-193). MIT Press.

Hernández y Hernández, D., Salado Rodríguez, L., & López González, R. (2019). Reflexiones sobre la literacidad: un punto de partida hacia lo digital. En L. M. Garay Cruz & D. Hernández Gutiérrez (Coords.), Alfabetizaciones digitales críticas (pp. 25-48). Universidad Autónoma Metropolitana Unidad Lerma; Juan Pablos Editor.

Hine, C. (2015). Ethnography for the Internet. Embedded, embodied and everyday. Bloomsbury Academic.

Kaiser, J., & Rauchfleisch, A. (2020). Birds of a feather get recommended together: algorithmic homophily in YouTube’s channel recommendations in the United States and Germany. Social Media + Society, 6(4). https://doi.org/10.1177/2056305120969914

Kearns, M., & Roth, A. (2019). The ethical algorithm. The science of socially aware algorithm design. Oxford University Press.

Kitchin, R. (2017). Thinking critically about and researching algorithms. Information, Communication & Society, 20(1), 14-29. https://doi.org/10.1080/1369118X.2016.1154087

Lugo Rodríguez, N. L. (2016). Diseño de narrativas transmedia para la transalfabetización [Tesis doctoral, Universitat Pompeu Fabra]. TDX. http://hdl.handle.net/10803/396131

Lukoff, K., Lyngs, U., Zade, H., Liao, J. V., Choi, J., Fan, K., Munson, S. A., & Hiniker, A. (2021). How the design of YouTube influences user sense of agency. En Proceedings of the 2021 CHI Conference on Human Factors in Computing Systems (pp. 1-17). https://doi.org/10.1145/3411764.3445467

Pariser, E. (2014). The filter bubble. How the new personalized web is changing what we read and how we think. Penguin Books.

Pasquale, P. (2016). The black box society. The secret algorithms that control money and information. Harvard University Press.

Pinch, T., & Bijker, W. (1989). The social construction of facts and artifacts: or how the sociology of science and sociology of technology might benefit each other. En W. E. Bijker, T. P. Hughes & T. Pinch (Eds.), The social construction of technological systems (pp. 17-30). MIT Press.

Ridley, M., & Pawlick-Potts, D. (2021). Algorithmic literacy and the role for libraries. Information Technology and Libraries, 40(2). https://doi.org/10.6017/ital.v40i2.12963

Rieder, B. (2020). Engines of order. Amsterdam University Press.

Rieder, B., Matamoros-Fernández, A., & Coromina, Ò. (2018). From ranking algorithms to ‘ranking cultures’: investigating the modulation of visibility in YouTube search results. Convergence, 24(1), 50-68. https://doi.org/10.1177/1354856517736982

Roberge, J., & Seyfert, R. (2018). What are algorithmic cultures? En R. Seyfert & J. Roberge (Eds.), Algorithmic cultures. Essays on meaning, performance and new technologies (pp. 13-37). Routledge. https://doi.org/10.4324/9781315658698-7

Scolari, C. (2016). Estrategias de aprendizaje informal y competencias mediáticas en la nueva ecología de la comunicación. Revista Telos, 103. https://telos.fundaciontelefonica.com/archivo/numero103/estrategias-de-aprendizaje-informal-y-competencias-mediaticas-en-la-nueva-ecologia-de-la-comunicacion/

Seaver, N. (2017). Algorithms as culture: some tactics for the ethnography of algorithmic systems. Big Data & Society, 4(2). https://doi.org/10.1177/2053951717738104

Siles, I., Segura-Castillo, A., Solís, R., & Sancho, M. (2020). Folk theories of algorithmic recommendations on Spotify: enacting data assemblages in the global South. Big Data & Society, 7(1). https://doi.org/10.1177/2053951720923377

Silge J., & Robinson D. (2016). tidytext: Text mining and analysis using tidy data principles in R. Journal of Open Source Software, 1(3), 37. DOI: 10.21105/joss.00037

Statista. (2021). YouTube penetration in selected countries and territories 2021. https://www.statista.com/statistics/1219589/youtube-penetration-worldwide-by-country/

Striphas, T. (2015). Algorithmic culture. European Journal of Cultural Studies, 18(4-5), 395-412. https://doi.org/10.1177/1367549415577392

Treré, E. (2019). Hybrid media activism. Ecologies, imaginaries, algorithms. Routledge.

Tufekci, Z. (2018, 10 de marzo). YouTube, the great radicalizer. The New York Times. https://www.nytimes.com/2018/03/10/opinion/sunday/youtube-politics-radical.html

Vega, F. (2021). El Estado de social media en América Latina. Comscore. https://www.comscore.com/lat/Prensa-y-Eventos/Presentaciones-y-libros-blancos/2021/El-Estado-de-Social-Media-en-America-Latina

Velkova, J., & Kaun, A. (2021). Algorithmic resistance: media practices and the politics of repair. Information, Communication & Society, 24(4), 523-540. https://doi.org/10.1080/1369118X.2019.1657162

We Are Social. (2020, 30 de enero). Digital 2020: el uso de las redes sociales abarca casi la mitad de la población mundial. https://wearesocial.com/digital-2020

YT Brandcast México. (٢٠٢٠, 23 de noviembre). YouTube Brandcast 2020 México [Video]. YouTube. https://www.youtube.com/watch?v=-xNbuFnpPbA